HCL Software steht mit klarem Commitment auch strategisch zu on prem-Lösungen als eine Option. Das bedeutet nicht, dass sich HCL neusten technischen Fortschritten verschließt, sondern vielmehr, dass HCL neue Technologien an allen möglichen Stellen für Kunden erschließt. Beim modernen, flexiblen Betrieb von und in Rechenzentren sind Cloud-native Technologien heute nicht mehr wegzudenken. Genau deshalb unterstützt HCL Software Cloud-Technologien mit immer mehr Lösungen.

Informationstechnologie ändert sich durch unüberschaubar viele Initiativen fortlaufend weiter. Manchmal zeichnen sich dabei neue Trends ab. So war es vor einigen Jahren das Thema „Public Cloud“ – oft auch verkürzt und damit irritierend einfach „Cloud“ genannt. Irritierend deshalb, weil Cloud letztlich ein Oberbegriff mit vielen Spielarten ist, womit jede Präzisierung hilfreich ist.

Public Cloud wurde und wird kontrovers diskutiert, gibt es doch (oft berechtigte) Sicherheitsbedenken und auch Fragen nach der Servicequalität. Zumindest die Sicherheitsbedenken kann man zu weiten Teilen reduzieren, wenn man das als „Cloud private“ selbst betreibt. Und dann gibt es verschiedene Einstiegsebenen: „Bare Metal“, also quasi nur nackte Hardware, PaaS (Platform as a Service, also Hardware mit Betriebssystem) oder auch SaaS (Software as a Service – die Komplett-Variante). Fast alle Ansätze haben einige Dinge gemeinsam, die Cloud-Ansätze von klassischen Implementierungen unterscheiden:

Lief in klassischer Weise früher eine Anwendung dediziert in einer virtuellen (oder physischen) Maschine, so laufen alles Services in einem Cloud-nativen Modell als verschiedene Module logisch in einer mehr oder weniger riesigen Maschine. Möglich ist das durch eine Containerisierung der Anwendungen, die in beliebiger Zahl und parallel auf Ressourcen zugreifen können. Der Aufstieg von Cloud-nativen-Computing-Plattformen wurde durch die breite Einführung von Docker und Kubernetes vorangetrieben.

Cloud-natives Computing revolutioniert in gewisser Weise die Bereitstellung, Implementierung und Wartung von Software – und die Vorteile für Unternehmen sind viel zu überzeugend, um sie zu ignorieren.

Auch wenn hier der Begriff „Cloud“ ins Spiel kommt, bedeutet das nicht, dass solche Implementierungen zwingend in einer Public Cloud Umgebung laufen müssen. Natürlich kann man in Public Clouds verschiedenster Anbieter die grundlegenden Services nutzen. Man kann solche Infrastrukturen aber auch im eigenen Rechenzentrum („on Premises“) aufbauen. Hierbei sollte man sich aber die Frage stellen, ob und wie das eigene Rechenzentrum die Vorteile auch entsprechend nutzen kann. Je größer es ist und je mehr Services diese neuen Möglichkeiten nutzen können, desto mehr Sinn wird es machen.

HCL Software hat es sich zur Aufgabe gemacht, Unternehmen darin zu unterstützen Software möglichst einfach nutzen zu können – sowohl als Endbenutzer, als auch im Rechenzentrumsbetrieb. Ein wichtiger Gesichtspunkt ist die schnellere und einfachere Installation, Ausführung und Aktualisierung von HCL Software, ohne jedoch die Zuverlässigkeit, Skalierbarkeit, Leistung, Sicherheit und Integrationsbreite zu opfern, die man zur Digitalisierung von Geschäftsprozessen benötigen.

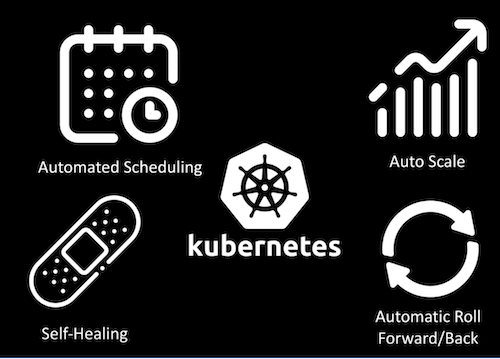

Wenn Unternehmen Anwendungen in einer Cloud-nativen Weise erstellen und betreiben, können sie neue Ideen schneller umsetzen und so schneller auf Kundenanforderungen reagieren. Warum ist das wichtig? Denken Sie als Analogie an ein Taxiunternehmen. Ein Taxi ist wie ein Container und die Abfertigungszentrale ist Kubernetes – es bietet eine wertvolle Orchestrierung, damit die einzelnen Taxis effizient dorthin gelangen können, wo sie hin müssen.

Docker plus Kubernetes bietet die Fähigkeit zur schnellen Anpassung in einer digitalen Welt, was für Unternehmen, die kontinuierlich wachsen, konkurrenzfähig sein müssen und Anwendungen in großem Maßstab und mit hoher Geschwindigkeit betreiben müssen, von grundlegender Bedeutung ist. HCL Software bietet heute bereits eine breite Unterstützung von Cloud-nativen Plattformen und wird dieses ausbauen.

So wird mit dem neuesten Update von HCL Digital Experience („Portal“) eine Unterstützung für Microsoft Azure AKS hinzugefügt, die sich der bereits angekündigten Unterstützung für RedHat Open Shift und Amazon EKS anschließt und den Kunden das breiteste Angebot an Cloud-Computing-Plattformoptionen für eine DX-Lösung bietet.

Das bedeutet, dass Kunden die Flexibilität und Portabilität haben, die sie benötigen, um die Lösung dort einzusetzen, wo, wann und wie es für ihre technischen Ziele am sinnvollsten ist. Da HCL Digital Experience jetzt auf Docker läuft, ist die anfängliche Installation auf jeder Plattform nun bis zu zehnmal schneller – das bedeutet nur Minuten, nicht Stunden, und Updates werden kontinuierlich geliefert, ohne störende Migrationen, was auch zu einer verbesserten Kosteneffizienz führt.

Darüber hinaus nutzt HCL Digital Experience, sobald es einmal installiert ist, alle Vorteile von Kubernetes für noch mehr Nutzen, einschließlich:

Da die HCL „cloud-nativ“ ist, kann sie auch Funktionen und Fähigkeiten modular bereitstellen, wie z. B. die neue HCL Digital Asset Management-Funktion, die auch im neuesten HCL DX-Update verfügbar ist (Out-of-the-Box und ohne zusätzliche Kosten!). Darüber hinaus steht ab sofort eine neue Content-Management-Funktion des Content Composer zur Verfügung, die Geschäftsanwendern hilft, den Zeitaufwand für die Erstellung und Pflege überzeugender digitaler Inhalte und Erlebnisse drastisch zu reduzieren.

Unser Cloud-Native-Ansatz bietet alle Vorteile einer traditionellen on Premises-Installation mit lokaler Kontrolle – für viele Unternehmen aus Sicherheits- und Leistungsgründen wichtig – aber jetzt mit den wirtschaftlichen Vorteilen der Cloud mit sofortigen Updates und minimaler Beteiligung der Entwickler. Für unsere Kunden bedeutet dies eine Reduzierung der Gesamtbetriebskosten (TCO) und einen massiven, positiven Return on Investment (ROI).

Auch HCL Domino ist bereits seit V10 als Docker-Container verfügbar und HCL Sametime V11.5 Meet, das noch in diesem Monat verfügbar werden wird, kommt als Docker-Container. Warum ist das wichtig und gut? Web-Meetings sind ein Thema, das hohe Skalierbarkeit erfordert: oft wollen nur wenige Personen Web-Meetings abhalten, nachts vielleicht fast gar keine. Aber zu anderen Tageszeiten oder an bestimmten Tagen kann es zu absoluten Leistungsspitzen kommen. Soll man dafür permanent die Rechenkapazität vorhalten, die man in der Leistungsspitze benötigt? Früher musste man es. Mit Cloud-native Technologien kann man die Leistung stattdessen dynamisch und automatisch zuteilen und entsprechend über viele Services verteilen. Das ist für einen Meeting-Service perfekt!

HCL Software arbeitet daran auch Domino im nächsten Release, also mit V12, noch weiter auf Cloud-native Infrastrukturen einzustellen, ohne dabei die Sicherheit und Automationsfähigkeiten, die Unternehmen und öffentliche Organisationen erwarten, einzuschränken. Domino wird alle führenden Container-Plattformen unterstützen und damit ein deutlich vereinfachtes Rollout für größere Umgebungen und neue Backup-Konzepte bieten. Das sind dann u.a. Kubernetes, AWS, OpenShift, Veeam, Cohesity, usw.

Was lerne ich da für mich daraus? Wer mit der Zeit geht, geht mit HCL Software!

Diese Woche bin ich besonders gespannt auf die #dnug47online Deep Dive Session der DNUG Fachgruppe Connections – u.a. mit Harald Schirmer (Continental AG), einem der Vordenker für Organisationserneuerung in Deutschland – und natürlich auch dem Thema Connections und Cloud-native.

Ich wünsche Ihnen eine schöne Woche!

Ihr

Tom Zeizel

Associate Vice President & Head of HCL Software in DACH

Abonniere unseren E-Mail-Newsletter und wir halten Dich mit Infos rund um die DNUG und ihre Events auf dem Laufenden.

Mit Deiner Anmeldung bestätigst Du, dass Du unsere Datenschutzbestimmungen gelesen hast und mit ihnen einverstanden bist.

Probleme mit dem Newsletter-Empfang? Versuch es mit diesen Tipps.